Handlungsrelevante Informationen

Die zentrale Anforderung an Bildverarbeitungssysteme in der Lebensmittelautomatisierung besteht darin, auch in anspruchsvollen Umgebungen zuverlässige Informationen zu gewinnen.

Die Bilddaten dieser Systeme müssen anschließend in übergeordnete Systeme einfließen, die prüfen, klassifizieren, führen und Aktionen auslösen. Von Bodenbearbeitung über Verarbeitung und Verpackung bis hin zu Lagerung und Logistik können die Anwendungen sehr unterschiedlich aussehen. Die zugrunde liegenden Bildverarbeitungsprobleme haben jedoch oft mehr gemeinsam, als es auf den ersten Blick scheint. Bei ihrer Lösung geht es nicht nur um Bildqualität, sondern auch um Kamerafunktionen, die bei der ersten Bewertung leicht übersehen werden und später für eine zuverlässige Systemintegration und einen stabilen Betrieb entscheidend sein können.

Unterschiedliche Anwendungen, ähnliche Herausforderungen

Automatisierung in der Lebensmittelindustrie umfasst eine große Bandbreite an Umgebungen und Aufgaben. Ein System muss möglicherweise Steine in einem staubigen Feld erkennen, Fische während der Handhabung klassifizieren, unregelmäßige organische Oberflächen für die robotergestützte Reinigung lokalisieren, verpackte Produkte trotz Reflexionen prüfen oder autonome Gabelstapler durch reflektierende Lagerinfrastruktur führen. Auf den ersten Blick scheinen diese Anwendungen kaum miteinander verbunden zu sein. Betrachtet man jedoch die grundlegenden Anforderungen an die Bildverarbeitung, wiederholen sich häufig dieselben zentralen Herausforderungen.

Biologische und umgebungsbedingte Variabilität

Die Natur ist nicht einheitlich. Lebensmittelprodukte, organische Oberflächen, Außenumgebungen und bewegte Zielobjekte unterscheiden sich stark in Größe, Form, Feuchtigkeit, Position und Erscheinungsbild.

Echtzeit-Entscheidungsfindung

In vielen Systemen reicht die Detektion allein nicht aus. Die Bilddaten müssen schnell genug verarbeitet werden, um innerhalb der zeitlichen Vorgaben des Prozesses eine Aktion auszulösen.

Optische Mehrdeutigkeit

Manchmal ist das für die Inspektion benötigte Signal im sichtbaren Licht schwach, verdeckt oder gar nicht vorhanden. Reflexionen, transparente Materialien, nasse Oberflächen und Defekte unter der Oberfläche können dazu führen, dass Standard-RGB-Bildgebung nicht ausreicht.

Diese drei Herausforderungen lassen sich nicht eins zu eins bestimmten Anwendungen zuordnen. Eine einzelne Anwendung kann mehrere davon gleichzeitig beinhalten. Genau deshalb kommen dieselben Kameratechnologien häufig in sehr unterschiedlichen Systemen zum Einsatz. Eine robuste 2D-Kamera, eine kompakte Embedded-Kamera, eine 3D-Time-of-Flight-Kamera, eine SWIR-Kamera oder eine Polarisationskamera kann in überraschend vielen Anwendungsfällen eine zentrale Rolle spielen, wenn die zugrunde liegende Bildverarbeitungsaufgabe ähnlich ist.

Über den Sensor hinaus:

Wichtige Kamerafunktionen für die Lebensmittelautomatisierung

Bildqualität und Sensorleistung sind wichtig, aber nicht die einzigen Kriterien bei der Auswahl einer Kamera für die Lebensmittelautomatisierung. In realen Systemen können auch Schutz gegen Umwelteinflüsse, kompakte Baugröße, Synchronisierung, Bandbreite, Triggerung sowie die Kompatibilität mit Software und Hardware von Drittanbietern entscheidend sein. In manchen Anwendungen sind leicht übersehene Merkmale wie robuste M12-Schraubverriegelungsstecker oder ein abgesetzter Sensorkopf wichtiger als Megapixel und Bildrate allein.

Robustes Design für einen stabilen Betrieb an Industrieanlagen

- Schock- und Vibrationszertifizierung

- Sichere Befestigungsbohrungen

- EN 60068-2-27, EN 60068-2-64, EN 60068-2-6

Umgebungsschutz für raue Einsatzbedingungen

- IP67-Staub- und Wasserschutz

- Großer Betriebstemperaturbereich

- Abgedichtete Steckverbinder

- Industrielle EMV-Störfestigkeit

Kompakter Formfaktor für beengte mechanische Einbauräume und Embedded-Systeme

- 24 x 24 mm, ca. 30 g

- 90°- und 180°-Formfaktor

- Abgesetzter Sensorkopf und verschiedene Anschlussoptionen

Timing und Synchronisierung zur Koordination mit Robotern, Förderbändern und anderen Geräten

- Zähler und Timer

- Chunk-Daten, Ereignisdaten

- Zeitstempel

I/O und Trigger für deterministische Bildaufnahme und Maschinensteuerung

- GPIO

- Optisch isolierte und nicht isolierte I/O

- PTP (IEEE 1588)

- Hardware- und Software-Trigger

Schnittstelle und Bandbreite für zuverlässiges Streaming

- Ethernet-basierte Kameras

- 1GigE, 2.5GigE, 5GigE

- 10GigE, 25GigE mit RDMA

Systemintegration und Kompatibilität

- Arena SDK, APIs, Codebeispiele

- Kompatibilität mit Drittanbieter-Software

- GigE Vision, Industriestandards

Vor diesem breiteren Blick auf die Kameraauswahl zeigen die nächsten Abschnitte, wie diese wiederkehrenden Bildverarbeitungs- und Integrationsherausforderungen in den einzelnen Stufen der Lebensmittelautomatisierung auftreten. Wir beginnen beim Boden, wo wechselnde Außenbedingungen, Bewegung und raue Einsatzbedingungen eine zuverlässige Detektion besonders anspruchsvoll machen.

Von Farm bis Gabelstapler: Boden, Verarbeitung, Verpackung, Lagerung

Boden:

Zielobjekte in rauen, unkontrollierten Umgebungen erkennen

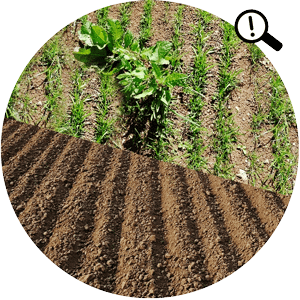

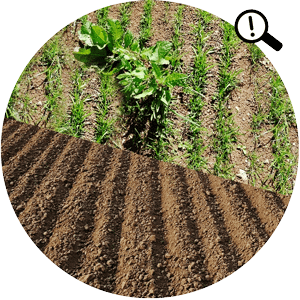

In der Bodenphase arbeiten Bildverarbeitungssysteme unter einigen der am wenigsten kontrollierten Bedingungen im gesamten Ablauf. Staub, Vibrationen, wechselnde Beleuchtung, bewegte Maschinen, Fremdkörper und unebenes Gelände erschweren die Erfassung nutzbarer Bilddaten. Die Herausforderung besteht nicht nur darin, ein Objekt zu „sehen“, sondern es zuverlässig zu erkennen, während sich die Umgebung ständig verändert.

Landwirtschaftliche Systeme im Außenbereich arbeiten selten unter stabiler Beleuchtung oder mit fest definierter Objektpräsentation. Zielobjekte können teilweise verdeckt, unregelmäßig geformt oder von anderen visuell störenden Elementen umgeben sein. Gleichzeitig ist die Maschine, an der die Kamera montiert ist, häufig in Bewegung, sodass Bildaufnahme, Verarbeitung und Aktion gemeinsam ablaufen müssen.

Kernaussage: In rauen Außenumgebungen sind Kamerarobustheit, Stabilität bei Bewegung und Echtzeitreaktion ebenso wichtig wie die Bildqualität.

Zentrale Herausforderungen

Biologische und umgebungsbedingte Variabilität

Echtzeit-Entscheidungsfindung

Steinlese

Steinlesesysteme müssen Fremdkörper während der Bewegung erkennen und dabei in Staub, Vibrationen und unkontrollierter Beleuchtung arbeiten. Dies ist ein gutes Beispiel dafür, wie robuste 2D-Bildgebung ein anspruchsvolles Praxisproblem lösen kann, wenn Bewegungsdarstellung und zuverlässige Triggerung wichtiger sind als perfekte Laborbedingungen.

Im System eingesetzte Kamera: Triton IP67-Kamera.

Eine robuste industrielle 2D-Kamera mit Global Shutter kann schnelle Szenen klar erfassen. IP67-Schutz sowie schock- und vibrationszertifizierte Hardware unterstützen den Außeneinsatz in schwierigem Gelände.

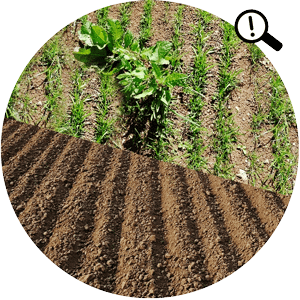

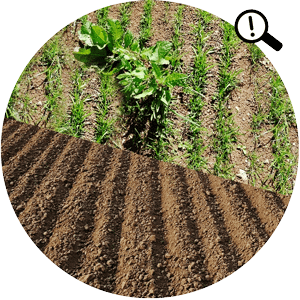

Pflanzenschutz-Sprühtechnik

Präzisionssysteme für das Ausbringen von Pflanzenschutzmitteln müssen Nutzpflanzen in sehr engen mechanischen Einbauräumen von Unkraut unterscheiden und anschließend lokal begrenzte Sprühentscheidungen in Echtzeit auslösen. Die größte Schwierigkeit liegt hier nicht nur in der Bildanalyse, sondern auch in der Integration des Bildverarbeitungssystems in bestehende Landmaschinen.

Im System eingesetzte Kamera: Phoenix Modulkamera.

Eine sehr kleine und leichte Kameraplattform ist oft wichtiger als die reine Sensorgröße. Formfaktor, Ausrichtungsoptionen und flexible Integration entscheiden darüber, ob ein System überhaupt eingesetzt werden kann.

Verarbeitung:

Biologische Komplexität in nutzbare Daten umwandeln

Automatisierung in der Lebensmittelverarbeitung erfordert, dass mehrere Geräte synchronisiert werden und deterministisch handeln. Auch wenn sich die Umgebung in dieser Phase verändert, treten viele der Herausforderungen aus der Bodenphase in anderer Form weiterhin auf, darunter Feuchtigkeit, Schmutz, Dampf, Washdown-Bedingungen und andere Quellen umgebungsbedingter Variabilität. Anwendungen müssen organische Zielobjekte mit variablen Oberflächen verarbeiten und enge Toleranzen einhalten. Gleichzeitig müssen sie präzise in 2D oder 3D klassifizieren, lokalisieren, messen, prüfen oder eine Aktion führen. Hier wird Lebensmittelautomatisierung besonders komplex.

In dieser Phase wird auch der Nutzen unterschiedlicher Sensorik-Modalitäten deutlicher. Einige Aufgaben basieren auf kompakter 2D-Klassifizierung. Andere erfordern 3D-Punktwolken oder Bildgebung jenseits des sichtbaren Lichts.

Kernaussage: In der Lebensmittelverarbeitung hängt zuverlässige Automatisierung davon ab, die Sensorik-Modalität passend zur Aufgabe auszuwählen, ob 2D-Klassifizierung, 3D-Führung oder Bildgebung jenseits des sichtbaren Lichts.

Zentrale Herausforderungen

Biologische und umgebungsbedingte Variabilität

Echtzeit-Entscheidungsfindung

Optische Mehrdeutigkeit

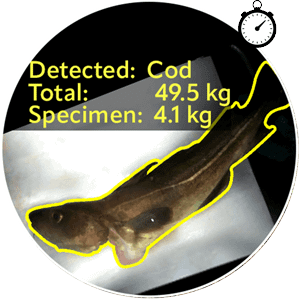

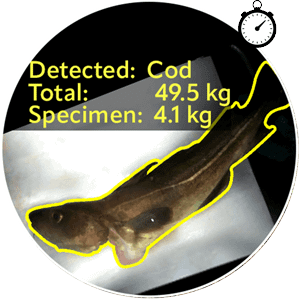

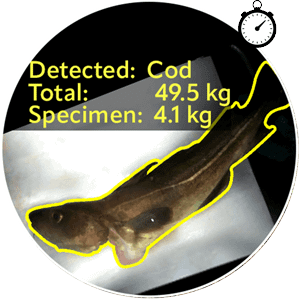

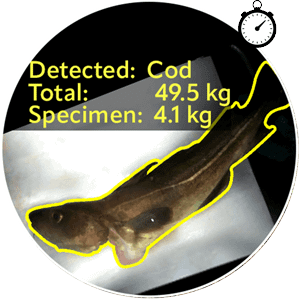

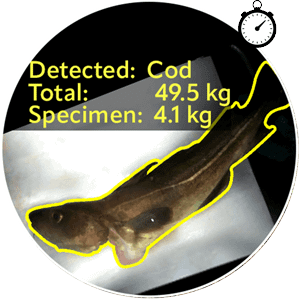

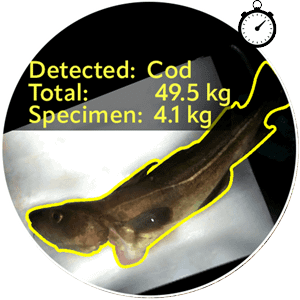

Fangregistrierung

Wenn Fische kontinuierlich erfasst und gehandhabt werden, muss das Bildverarbeitungssystem Arten klassifizieren, Größe oder Biomasse abschätzen und Objekte bei wechselnder Bewegung und Beleuchtung verfolgen. Dies ist ein gutes Beispiel dafür, wie biologische Variabilität und Echtzeit-Entscheidungsfindung in einem System zusammenkommen.

Im System eingesetzte Kamera: Phoenix Modulkamera.

Eine kompakte Kamera kann direkt am Erfassungspunkt innerhalb eines Systemgehäuses integriert werden, wo der verfügbare Platz begrenzt und die Handhabungsbedingungen unvorhersehbar sein können.

Kuhreinigung

In vielen automatisierten Anwendungen in der Lebensmittelproduktion müssen Roboter mit einem lebenden Tier oder einer anderen nicht starren biologischen Oberfläche interagieren. In solchen Situationen ist 3D-Geometrie entscheidend. Die Herausforderung besteht nicht nur darin, das Zielobjekt zu sehen, sondern unter nassen, reflektierenden und bewegten Bedingungen stabile Punktwolkendaten zu erfassen.

Im System eingesetzte Kamera: Helios2+ 3D-ToF-IP67-Kamera.

Die 3D-Time-of-Flight-Kamera von LUCID kann die für die Roboterführung benötigten Tiefendaten bereitstellen. HDR und industrieller Schutz nach IP67 tragen dazu bei, die Zuverlässigkeit auch unter schwierigen Einsatzbedingungen aufrechtzuerhalten.

Lebensmittelsicherheit

Bei der Inspektion der Lebensmittelsicherheit können Verunreinigungen auf unregelmäßigen Schlachtkörperoberflächen unter nassen und reflektierenden Bedingungen auftreten, häufig bei begrenzter Inspektionszeit. Die Herausforderung besteht nicht nur darin, die Verunreinigung zu erkennen, sondern sie genau genug zu kartieren, damit sie in nachgelagerten Schritten entfernt oder behandelt werden kann.

Empfohlene Kamera: Helios2 Chroma RGB-D-IP67-Kamera.

Ein RGB-D-Kamerasystem kombiniert Farbe und Tiefe. Dadurch lässt sich eine erscheinungsbasierte Detektion leichter mit räumlichen Aktionen verknüpfen, während die Integrationskomplexität gegenüber dem Aufbau separater 2D- und 3D-Systeme von Grund auf reduziert wird.

Materialanalyse

Manche Herausforderungen in der Verarbeitung haben nichts mit Geometrie zu tun. Druckstellen, Feuchtigkeitsunterschiede und subtile Materialabweichungen können physisch vorhanden sein, lassen sich mit Standardbildgebung im sichtbaren Spektrum jedoch nur schwer oder gar nicht unterscheiden. Wenn sichtbares Licht nicht ausreicht, müssen Ingenieure andere Wellenlängen oder Eigenschaften des Lichts nutzen, um den erforderlichen Kontrast zu erzeugen.

Empfohlene Kameras: Atlas SWIR und Triton SWIR IP67-Kameras.

SWIR-Bildgebung erweitert den nutzbaren Wellenlängenbereich über sichtbares Licht hinaus. Dadurch kann das System Informationen über Feuchtigkeitsgehalt, Druckstellen und Materialeigenschaften erfassen, die Standard-RGB-Kameras möglicherweise nicht erkennen.

Verpackung:

Zuverlässige Inspektion reflektierender Verpackungen und variabler Ausrichtungen

Wenn Produkte die Verpackungsphase erreichen, haben sich viele Herausforderungen verlagert. Das Zielobjekt ist nun möglicherweise in Form und Position besser kontrolliert, doch die Verpackungsmaterialien selbst erzeugen häufig neue optische Probleme. Kunststofffolien, Schrumpffolie, glänzende Etiketten, versiegelte Schalen und transparente Oberflächen können die Inspektion stören, indem sie Reflexionen erzeugen oder wichtige Details verdecken. Gleichzeitig muss das System bei kontinuierlichem Betrieb Geschwindigkeit und Wiederholgenauigkeit beibehalten, auch wenn sich die Produktausrichtung ändert.

Kernaussage: In der Verpackungsautomatisierung ist ausreichender Kontrast zur Defekterkennung oder zur Bestimmung der Objektausrichtung nur ein Teil der Herausforderung. Timing, Synchronisierung und Integration der Kamera in die Gesamtmaschine sind oft ebenso wichtig.

Zentrale Herausforderungen

Echtzeit-Entscheidungsfindung

Optische Mehrdeutigkeit

Folieninspektion

Bei der Folieninspektion ist das relevante Signal möglicherweise bereits vorhanden, wird jedoch durch Reflexionen von Kunststofffolien oder glänzenden Oberflächen schwer erfassbar. Standardbildgebung kann hier an Grenzen stoßen, weil spiegelnde Reflexionen die für die Inspektion benötigten Details verdecken.

Im System eingesetzte Kamera: Triton Polarization und Phoenix Polarization Kamera.

Polarisationsbildgebung kann spiegelnde und diffuse Reflexion trennen. Dadurch lassen sich Oberflächendetails leichter sichtbar machen, Inspektionen unter reflektierenden Verpackungsbedingungen durchführen und Defekte in der Folie selbst erkennen.

Blisterverpackung

Bei Blisterverpackungen und Pick-and-Place-Systemen besteht die Aufgabe häufig darin, verpackte Artikel zu identifizieren, ihre Position und Ausrichtung zu bestimmen und Koordinaten an einen Roboter oder einen nachgelagerten Prozess zu senden. Auch wenn die Produkte regelmäßiger geformt sind, muss das System weiterhin reflektierende Materialien und unübersichtliche Anordnungen beherrschen und rund um die Uhr zuverlässig arbeiten.

Im System eingesetzte Kamera: Triton IP67-Kamera.

Eine industrielle 2D-Kamera mit Synchronisierungsfunktionen kann wiederholbare Detektion, präzises Timing und die Koordination mit Robotern unterstützen. In diesen Anwendungen können Funktionen wie Hardware-Triggerung, PTP, Zeitstempel, Action Commands und Kompatibilität mit Drittanbieter-Software genauso wichtig sein wie der Sensor selbst.

Lagerung und Logistik:

Echtzeitwahrnehmung für sichere Materialbewegungen

In Lagerung und Logistik geht es weniger um die Inspektion eines Produkts, sondern stärker um das Verständnis einer Umgebung in Bewegung. Autonome Gabelstapler, Palettenhandhabungssysteme und andere Logistikplattformen müssen den Raum um sich herum kontinuierlich erfassen, Objekte und Strukturen erkennen und sichere Navigations- oder Positionierungsentscheidungen in Echtzeit treffen.

Hier wird industrielle Bildverarbeitung Teil eines stärker autonomen Systems. Lagerung und Logistik vereinen viele der zuvor im Ablauf gesehenen Herausforderungen: umgebungsbedingte Variabilität, begrenzten Kontrast auf reflektierenden Oberflächen und die Notwendigkeit von Echtzeitaktionen. Hier speisen die Bilddaten jedoch ein kontinuierliches Wahrnehmungssystem und nicht ein einzelnes Inspektionsereignis.

Kernaussage: In der autonomen Logistik besteht das Ziel nicht nur darin, 3D-Daten zu erfassen, sondern kontinuierlich zuverlässige räumliche Informationen für sichere Navigation und Positionierung bereitzustellen.

Zentrale Herausforderungen

Biologische und umgebungsbedingte Variabilität

Echtzeit-Entscheidungsfindung

Optische Mehrdeutigkeit

Autonome Gabelstapler

Autonome Gabelstaplersysteme müssen durch dynamische Lagerumgebungen navigieren, Regalpositionen erkennen, Abstände abschätzen und sicher in der Nähe reflektierender Industrieoberflächen und bewegter Hindernisse arbeiten. Selbst wenn der Workflow strukturiert ist, bleibt die Umgebung selten statisch.

Im System eingesetzte Kamera: Helios2+ 3D-ToF-IP67-Kamera.

Die 3D-Time-of-Flight-Kamera von LUCID kann die für die Roboterführung benötigten Tiefendaten bereitstellen. HDR und industrieller Schutz nach IP67 tragen dazu bei, die Zuverlässigkeit auch unter schwierigen Einsatzbedingungen aufrechtzuerhalten.

Unterschiedliche Anwendungen. Gemeinsame Bildverarbeitungsherausforderungen.

Über Boden, Verarbeitung, Verpackung und Lagerung hinweg können Systeme der Lebensmittelautomatisierung sehr unterschiedlich aussehen. Dennoch wiederholen sich häufig dieselben zentralen Bildverarbeitungsherausforderungen. Biologische und umgebungsbedingte Variabilität, Echtzeit-Entscheidungsfindung und optische Mehrdeutigkeit treten entlang des Workflows in verschiedenen Kombinationen auf. Deshalb können dieselben Kameratechnologien sehr unterschiedliche Anwendungen unterstützen. Eine erfolgreiche Anwendung hängt von mehr ab als nur von der Sensorik-Modalität. Robustes Design, Synchronisierung, Triggerung, Bandbreite, Softwareunterstützung und Systemintegration spielen bei einer zuverlässigen Implementierung oft eine ebenso wichtige Rolle.

Das Ziel besteht nicht einfach darin, Bilder aufzunehmen, sondern zuverlässige Daten bereitzustellen, die übergeordnete Systeme in Aktionen umsetzen können.

Übersicht der Sensorik-Modalitäten

Biologische und umgebungsbedingte Variabilität

Außenbedingungen, Feuchtigkeit, Bewegung, unregelmäßige Geometrien sowie wechselnde Größe, Form und Position der Zielobjekte.

Robuste 2D-/3D-Bildverarbeitung, kompakte Embedded-Lösungen

Nutzen Sie robuste Gehäuse, kompakte Formfaktoren oder Tiefenerfassung, wenn die Szene physisch variabel und schwer kontrollierbar ist.

Echtzeit-Entscheidungsfindung

Die Detektion muss unmittelbar Aktionen von Robotern, Förderbändern, Sprühsystemen oder autonomen Systemen auslösen.

Synchronisierung, Trigger, Bandbreite, 2D/3D

Wenn Bilddaten direkt Aktionen steuern müssen, werden Kameratiming, Triggersteuerung und zuverlässiges Streaming entscheidend.

Optische Mehrdeutigkeit

Der erforderliche Kontrast kann durch Reflexionen, Transparenz, nasse Oberflächen oder die Grenzen des sichtbaren Lichts verdeckt werden.

SWIR, Polarisation, RGB-D

Gehen Sie über Standard-RGB hinaus, wenn das Signal schwach, verdeckt oder reflektierend ist oder wenn Farbe und Tiefe präzise aufeinander abgestimmt werden müssen.