Aktive Sensorausrichtung

So können Entwickler von Bildverarbeitungsanwendungen ihre optischen Spezifikationen zuverlässig einhalten, ohne bei der Skalierung der Anwendung ständig nachzujustieren. Stellen Sie sich vor, Sie bauen mehrere identische Prüfstationen, müssen aber bei jeder Kamera die Optik neu anpassen – oder Geräte zurücksenden, weil Spezifikationen außerhalb der Toleranz liegen. LUCID setzt die Aktive Sensorausrichtung bereits in der Fertigung ein, um Abweichungen zu minimieren und bei jeder Triton- und Atlas-Kamera gleichbleibend hohe Bildqualität sicherzustellen.

Inhaltsverzeichnis

In einer idealen Welt …

In einer idealen Welt wären optisches Zentrum, Neigung, Rotation und Back Focal Distance (BFD) bei jeder Kamera identisch. Die Sensorplatzierung würde einmal spezifiziert und verifiziert und anschließend in der Fertigung für alle Einheiten übernommen. In der Praxis gibt es jedoch kleine Unterschiede zwischen Bauteilen, etwa bei Winkel, Zentrum oder Tiefe des Objektivgehäuses im Verhältnis zur Sensorposition auf der Leiterplatte.

Oben: Wären alle Komponenten perfekt gefertigt, ließe sich der Sensor in jeder Einheit exakt gleich positionieren.

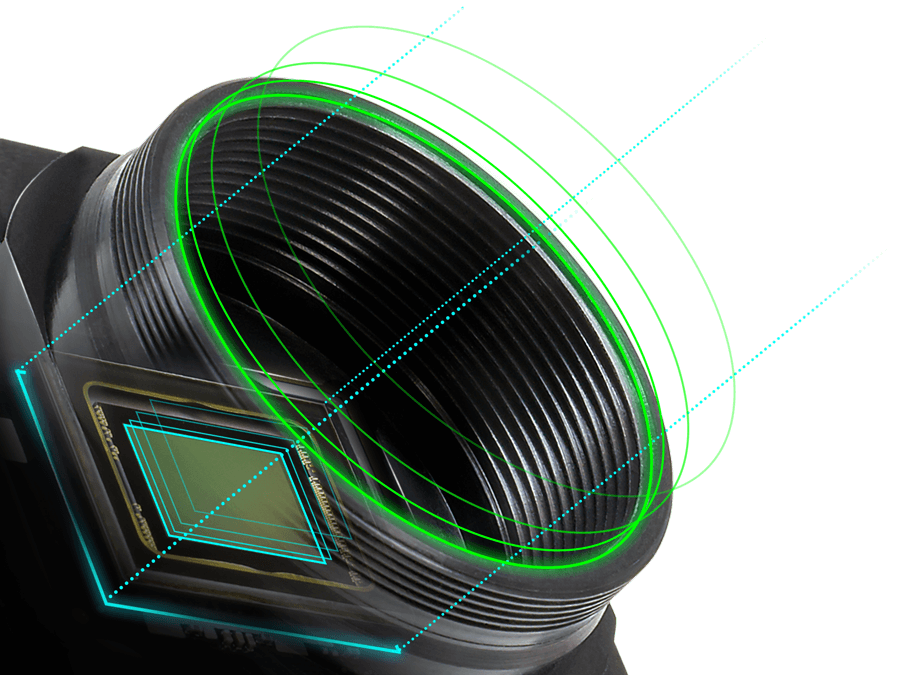

Oben: Stark überzeichnete Darstellung typischer Variablen in Kamerakomponenten. Sie führen zu Abweichungen bei der exakten Sensorplatzierung im Gehäuse.

Herausforderungen bei der Sensorplatzierung

Schon kleinste Unterschiede, etwa variierende Lötstärken unter dem Bildsensor oder ein leicht geneigter Sensorchip im Gehäuse, wirken sich spürbar auf die Bildqualität aus. Das führt zu Unterschieden in der Back Focal Distance über die Sensorfläche und kann zum Beispiel unscharfe Ecken verursachen. Die folgenden Animationen zeigen überzeichnete Beispiele typischer Probleme bei ungenau ausgerichteten Sensoren.

Links: Sensorkippung verursacht unterschiedliche Brennpunkte über die Sensorfläche. Mitte: Eine abweichende Sensorrotation erschwert die Kameramontage. Rechts: Ein leicht versetztes Objektivgehäuse kann zu abgedunkelten Ecken führen.

Herausforderungen bei der Sensorplatzierung

Schon kleinste Unterschiede, etwa variierende Lötstärken unter dem Bildsensor oder ein leicht geneigter Sensorchip im Gehäuse, wirken sich spürbar auf die Bildqualität aus. Das führt zu Unterschieden in der Back Focal Distance über die Sensorfläche und kann zum Beispiel unscharfe Ecken verursachen. Die folgenden Animationen zeigen überzeichnete Beispiele typischer Probleme bei ungenau ausgerichteten Sensoren.

Links: Sensorkippung verursacht unterschiedliche Brennpunkte über die Sensorfläche. Mitte: Eine abweichende Sensorrotation erschwert die Kameramontage. Rechts: Ein leicht versetztes Objektivgehäuse kann zu abgedunkelten Ecken führen.

Passive Ausrichtung

Die traditionelle Methode, Sensor und optischen Strahlengang aufeinander abzustimmen, basiert auf engen Toleranzen der Kamerakomponenten. Hersteller beziehen Bauteile von verschiedenen Zulieferern und müssen die Einhaltung der Spezifikationen sicherstellen. Anschließend wird die Kamera montiert – in der Hoffnung, dass alles exakt passt. Dies wird als Passive Ausrichtung bezeichnet.

Um fehlerhafte Kameras vor dem Versand zu erkennen, wird nach der Montage üblicherweise ein Bildqualitätstest durchgeführt. Das ist wirksam, aber zeitaufwendig und teuer. Fällt eine Kamera durch, ist sie bereits komplett montiert. Der Hersteller muss entscheiden, ob sie zerlegt, nachgearbeitet oder verworfen wird. Zusätzlich sind betroffene Bauteilchargen zu identifizieren. Das erzwingt engere Toleranzen, erhöht Kosten und Ausschuss. Manche Hersteller verzichten daher auf Tests oder weiten Toleranzen, was zulasten der Qualität geht.

Aktive Sensorausrichtung: Exakte Platzierung ab Werk

Eine deutlich präzisere und effizientere Methode zur korrekten Sensorplatzierung ist die Aktive Sensorausrichtung. Während des Einbaus misst das System Bildzentrum, Rotation, Neigung und Back Focal Distance und passt die Sensorposition aktiv anhand optischer Rückmeldungen an. Dazu nutzt es eine automatisierte 6-DoF-Mechanik und eine Prüfeinheit. Diese projiziert ein Muster auf die Sensorfläche und bewertet die Gleichmäßigkeit der Schärfe. Erkennt das System eine Ecke mit Unschärfe, korrigiert es die Neigung, bis der Fokus stimmt. Sobald die maximale Schärfe über die gesamte Sensorfläche erreicht ist, werden die Komponenten fixiert.

Links: Ein Lichtmuster wird auf den Sensor projiziert. Abweichungen in Neigung, Rotation oder Tiefe verzerren das Muster. Diese Verzerrungen werden vom 6-DoF-System (rechts) erfasst und kompensiert, sodass der Sensor in Echtzeit korrekt positioniert wird.

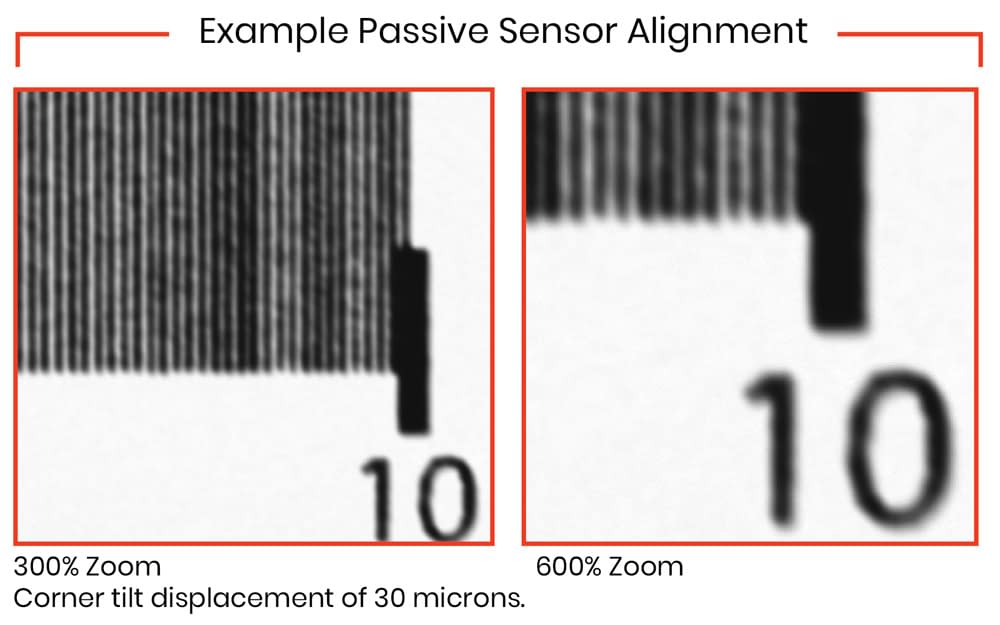

Beispielsimulation: 30 µm Eckversatz

Nachfolgend simulierte Beispielbilder eines 12,3-MP Sony IMX304 CMOS-Sensors (Format 1,1″) mit 6-mm-Objektiv bei f/2,8. Das Beispiel mit passiver Ausrichtung zeigt einen simulierten Eckversatz von 30 µm. Solche Abweichungen können u. a. durch unterschiedliche Mengen an Lotpaste im oder am Sensorgehäuse entstehen. Das Active Sensor Alignment von LUCID ermöglicht präzise Justagen im Mikrometerbereich und reduziert diese Einflüsse.

Fazit

Dieses Verfahren ermöglicht eine hochpräzise Sensorplatzierung mit linearer Ausrichtungs- und Neigungsauflösung im Mikrometerbereich. Kleinere Sensoren profitieren von exakter Zentrierung, da schon geringe Verschiebungen die Montage beeinflussen. Bei größeren Sensoren können minimale Neigungen deutliche Unterschiede in den Fokusebenen verursachen. Für Anwendungen mit höchsten Genauigkeitsanforderungen ist die Aktive Sensorausrichtung ein entscheidender Fertigungsschritt, der eine bessere Bildschärfe erzielt als herkömmliche passive Verfahren.