Intelligenter an der Quelle: On-Sensor-AI-Verarbeitung

Inhaltsverzeichnis

Sony IMX501: Bildgebung und Intelligenz in einem Paket

On-Sensor-AI vs. traditionelle Verarbeitung

Klassische Machine-Vision-Sensoren liefern Rohdaten und delegieren Verarbeitung und Analyse an externe Systeme wie PCs oder Cloud-Server. Das unterstützt große Modelle und flexible Vor-/Nachverarbeitung, erhöht aber Latenz, Leistungs- und Bandbreitenbedarf und macht Systeme komplexer und teurer.

Mit integrierter KI-Verarbeitung im Sensor steigen Effizienz und Reaktionsgeschwindigkeit, während Host-Ressourcen frei werden. On-Device laufende Modelle erlauben unmittelbare Inferenz ohne Übertragung großer Bilddaten. Trotz schlanker Rechenressourcen deckt diese Architektur viele Anwendungsfälle ab und liefert praxisgerechte Performance. Das Ergebnis sind schnellere Entscheidungen, geringere Bandbreite und kompaktere, kosteneffizientere Systeme.

Gestapelte AI-Sensor-Architektur

IMX501 steht für eine neue Klasse intelligenter Sensoren. Der rückseitig belichtete CMOS-Rolling-Shutter-Sensor mit 12,3 MP (4056 × 3040 px) integriert eine On-Sensor-AI-Engine mit CNN-Prozessor. Zentrale Komponenten: ein ISP zur Vorverarbeitung der Eingangsbilder, ein DSP-Subsystem für CNN-Operationen und 8 MB L2-SRAM für Gewichte und Laufzeitdaten. Die AI-Logik sitzt auf einem separaten Die, gestapelt unter dem Sensordie. So läuft die Inferenz vollständig im Paket mit schnellem Datentransfer zwischen beiden Dies. Intern sind bei voller Auflösung etwa 30 Bilder/s möglich. Die tatsächliche Bildausgabe hängt von der Bandbreite zwischen Sensor und FPGA ab, die Inferenzzeit vom Modell. Zusätzlich begrenzt die 1GigE-Schnittstelle die maximale Gesamtausgabe.

Gestapelte Sensor- und AI-Dies ermöglichen schnellen On-Package-Datentransfer mit ca. 30 fps bei 12,3 MP. Die reale Leistung hängt von Sensor-FPGA-Bandbreite, Modellkomplexität und den Limits der 1GigE-Schnittstelle ab.

| Triton Smart Bildraten (max. fps) |

7,9 fps @ 12,3 MP (Vollbild mit Objekterkennung) 29 fps (4×4 Bild mit Objekterkennung) 8,0 fps @ 12,3 MP (Vollbild mit Klassifikation / Anomalieerkennung) 30 fps (4×4 Bild mit Klassifikation / Anomalieerkennung) |

Parallele DSP-Kerne für effiziente AI-Inferenz

Herzstück der KI-Verarbeitung ist das DSP-Subsystem mit einem High-Computation-Intensity (CI) DSP-Kern, einem Standard-CI DSP-Kern und Tensor-DMAs (TDMAs). Beide Kerne arbeiten parallel, führen neuronale Operationen aus und verschieben Daten über die TDMA in den L2-Speicher. Bild- und Inferenzdaten werden anschließend über MIPI an das FPGA der Kamera übertragen.

Der CNN-Prozessor umfasst einen Standard-CI und einen High-CI DSP-Kern. Beide enthalten mehrere Processing Elements (PE), Memory-Access-Einheiten (ME) und Register (RE). Die Architektur liefert genügend Rechenleistung für Klassifikation, Detektion und Anomalie-Modelle.

Der Standard-CI DSP-Kern ist für allgemeine, unregelmäßige und sequentielle Aufgaben optimiert, sodass der High-CI DSP-Kern für rechenintensive Operationen frei bleibt. Aufgrund höherer Speicherzugriffe integriert der Standard-CI mehr Memory Engines (ME).

Der High-CI DSP-Kern ist für Hochdurchsatzaufgaben wie Faltungen und Matrixoperationen ausgelegt und nutzt Daten wieder, um Speicherzugriffe zu minimieren. Er integriert mehr Processing Elements (PE) und eine größere Register-Kapazität (RE).

Die Sensorarchitektur ermöglicht energieeffiziente KI-Inferenz und benötigt bei voller Auflösung etwa 280 mW. Die Inferenz läuft vollständig offline ohne Internet- oder Cloud-Verbindung. Das passt zu abgeschotteten Automatisierungsnetzwerken, reduziert externe Abhängigkeiten und potenzielle Ausfallpunkte.

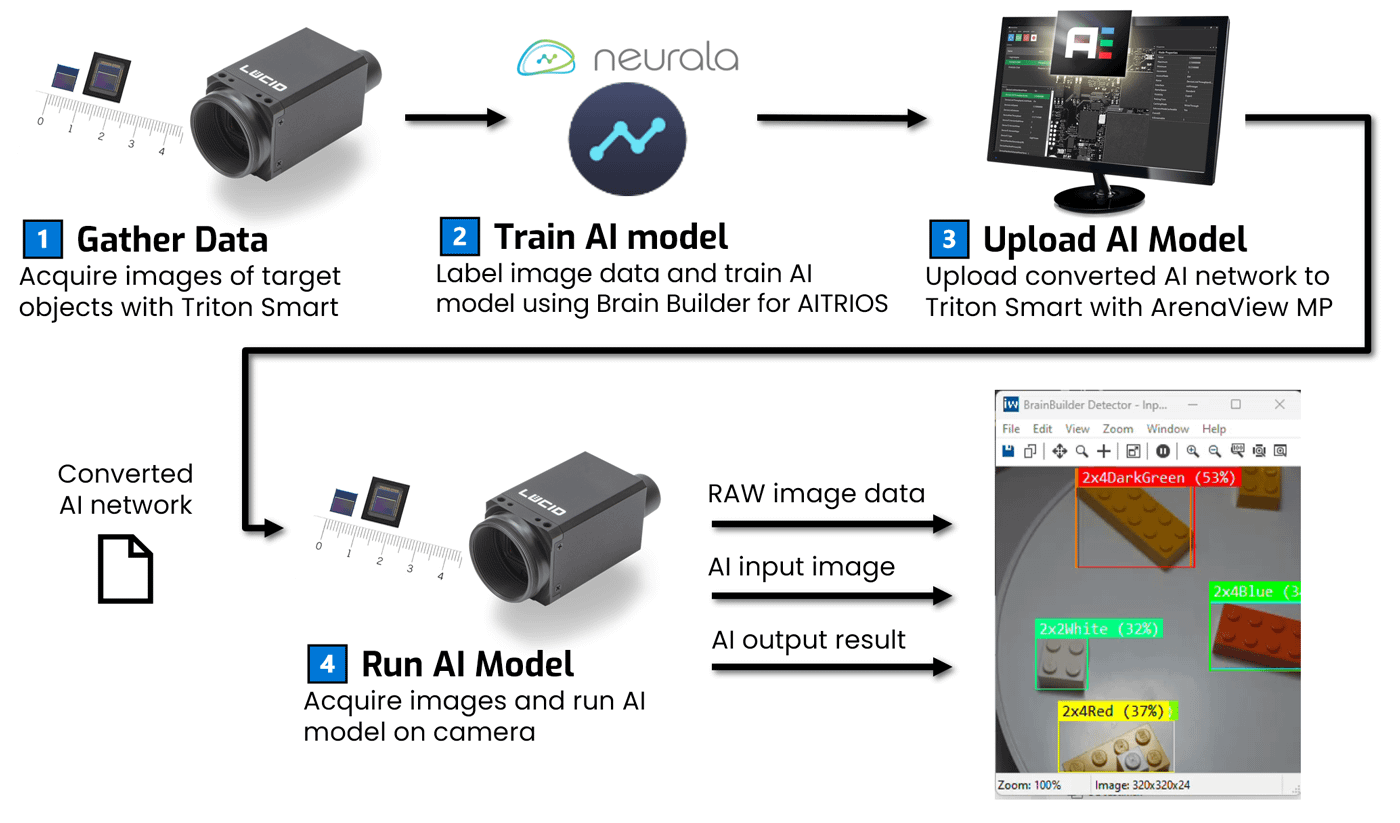

Brain Builder für AITRIOS: Präzise Modelle ohne Deep-Learning-Expertise

Um die On-Sensor-AI des IMX501 auszuschöpfen, braucht es eine angepasste Software-Pipeline mit strikten Speicherbudgets. Triton Smart nutzt dafür eine spezielle Version von Neuralas Brain Builder: Brain Builder für AITRIOS. Die Plattform erzeugt für Klassifikation und Objekterkennung präzise Modelle ab rund 50 Bildern pro Klasse und übernimmt Optimierung, Architekturwahl und die nahtlose Integration mit Triton Smart. Manuelles Pruning, Kompression oder Tuning entfallen. So wird die Modellerstellung effizient und auch ohne Deep-Learning-Know-how zugänglich.

Datasets hochladen, Klassen definieren und Bilder labeln. Vor dem Training zeigt die Übersicht den Label-Status je Klasse.

(Das Video nutzt ein Beispieldataset aus dem Brain-Builder-Softwarepaket. Einige Phasen sind gekürzt oder beschleunigt, alle Kernaussagen bleiben erhalten.)

Grundschritte in Brain Builder für AITRIOS: 1) Projekt benennen. 2) Modelltyp wählen. 3) Bilder hochladen. 4) Klassen anlegen. 5) Bilder annotieren. 6) Trainingsumfang wählen und trainieren.

Triton Smart: Robuste AI am Edge

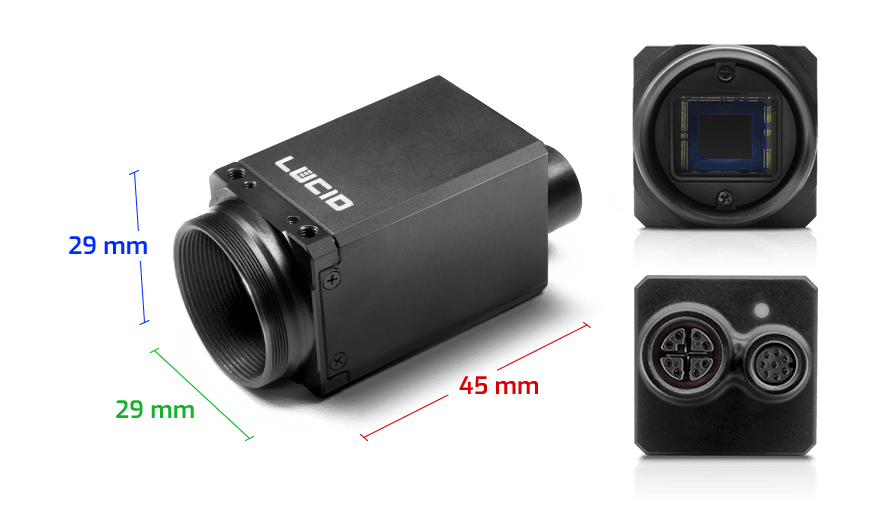

29 x 29 mm

67 Gramm

M12-/M8-Anschlüsse

Umgebung -20 °C bis 55 °C

Triton Smart integriert den IMX501 in ein kompaktes, leichtes Gehäuse (67 g, 29 × 29 mm) für industrielle Umgebungen. Das robuste zweiteilige Aluminiumgehäuse ist abgedichtet und mit vier M2-Schrauben gesichert, M12- und M8-Anschlüsse sorgen für zuverlässige Ethernet- und GPIO-Verbindungen. Für staubige oder nasse Bereiche steht ein optionaler IP67-Objektivtubus zur Verfügung – ein separates Gehäuse ist nicht erforderlich.

Mit einem weiten Umgebungstemperaturbereich (-20 °C bis 55 °C) sowie Stoß- und Vibrationsfestigkeit ist Triton Smart für den Langzeiteinsatz auf dem Shopfloor, in Logistikzentren und bei Außeninstallationen ausgelegt.

Dual-ISPs

Triton Smart nutzt ein Dual-ISP-Design für gleichzeitige KI- und Bildverarbeitung. Der integrierte ISP des IMX501 bereitet Bilder als Eingabetensor für die AI-Engine auf. Modellabhängig gelten 256 × 256 Pixel für Klassifikation, 320 × 320 Pixel für Objekterkennung und 512 × 512 Pixel für Anomalieerkennung. Nach der Inferenz entsteht ein Ausgabetensor; beide Tensoren enthalten die KI-Ergebnisse.

Parallel läuft der Rohbildstrom über einen zweiten ISP im FPGA, der die klassische Bildverarbeitung einer Standard-Machine-Vision-Kamera übernimmt. Die KI-Ergebnisse werden als Chunk-Daten eingebettet und mit dem finalen Bild kombiniert, sodass der Host Bild und Metadaten in einem Datenstrom erhält. Es stehen drei Ausgabemodi zur Verfügung: reguläres Bild, Eingabetensor (herunterskaliertes Bild) und Ausgabetensor (Inferenzresultate). Für höhere Bildraten oder strikteren Datenschutz kann das reguläre Bild auf 4 × 4 Pixel reduziert werden, während Ein- und Ausgabetensor übertragen werden. Bei 4056 × 3040 px und gleichzeitiger KI-Inferenz liefert die Kamera 8,3 fps, mit reduziertem Bild bis zu 30 fps.

Die Dual-Path-Architektur ermöglicht hochwertige Bildgebung und KI-Inferenz in Echtzeit, inklusive Standardfunktionen der Kameraverarbeitung wie Gain, Gamma, Black Level, Weißabgleich, LUT, CCM, Pixelkorrektur, Farbton, Sättigung, Farbraumkonvertierung und ROI.

Praxisanwendungen

Mit eingebetteter KI-Inferenz in der Kamera eignet sich Triton Smart überall dort, wo geringe Latenz, Offline-Fähigkeit und Energieeffizienz zählen. Typische Felder sind Smart Manufacturing mit Inline-Fehlererkennung, Komponentenprüfung und vorausschauender Wartung; Retail und Smart-Kioske mit Bestandsverfolgung, Regal-Analysen und kassenlosen Checkouts; Logistik und Lagerhaltung mit Echtzeit-Sortierung, Label-Erkennung und Behälterverifikation sowie Zutrittskontrolle und öffentliche Sicherheit mit Eindringlingserkennung, Personenzählung und Überwachung von Sicherheitszonen.

AI näher an die Datenquelle bringen

On-Sensor-AI definiert die Möglichkeiten am Edge neu. Triton Smart ersetzt keine leistungsstarken AI-Server, bietet jedoch für viele industrielle und Embedded-Anwendungen ein ausgewogenes Verhältnis aus Effizienz und Leistung. Durch die Verlagerung der Entscheidungsfindung in den Sensor sinkt die Systemkomplexität, die Reaktionsfähigkeit steigt, und die Lösung arbeitet unabhängig von Cloud oder Host. In Kombination mit intuitiven Tools wie Brain Builder für AITRIOS sinken die Hürden für KI in der industriellen Bildverarbeitung – intelligente Automatisierung wird für mehr Anwender erreichbar.

In Brain Builder für AITRIOS erstellte Modelle lassen sich mit ArenaView MP auf Triton Smart laden. Echtzeit-Inferenzresultate werden in ArenaView MP visualisiert.